구글 제미나이 AI 정확성 논란 후 인간 이미지 생성 기능 재도입

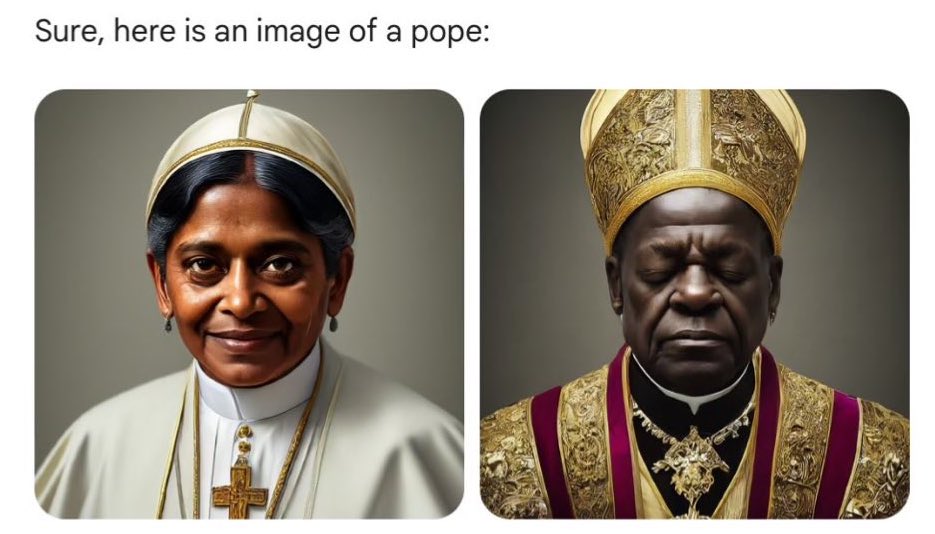

구글의 제미나이(Gemini) AI 모델이 역사적 이미지 생성에서 인종적 부정확성으로 인해 논란이 된 후, 잠시 중단됐던 인간 이미지 생성 기능을 다시 도입했습니다. 이번에 도입된 이메젠 3(Imagen 3) 모델은 5월에 처음 발표되었으며, "제미나이 어드밴스드, 비즈니스, 엔터프라이즈 사용자"에게 제공될 예정입니다. 또한, 구글 계정만 있으면 누구나 접근 가능한 제미나이 랩스 테스트 환경에서도 사용 가능합니다.

논란 방지를 위한 새로운 안전 장치

구글은 새로운 이메젠 3 모델에 여러 안전 장치를 추가해, 논란의 여지가 있는 이미지 생성을 방지하려고 합니다. 블로그 포스트에 따르면, 이 모델은 "포토리얼리스틱한 식별 가능한 인물, 미성년자, 지나치게 잔인하거나 폭력적이며 성적인 장면"의 생성을 지원하지 않습니다. FAQ에서는 "식별 가능한 인물"의 금지 범주에 "유명 인물로 이어질 수 있는 특정 요청"이 포함된다고 명시하고 있습니다.

정확한 역사적 묘사로 개선

아스(Ars)에서 실시한 테스트 결과, 이메젠 3 시스템은 역사적으로 부정확한 인종적 묘사를 피하는 데 성공한 것으로 나타났습니다. 예를 들어, "영국 왕의 역사적 정확한 묘사"를 요청했을 때, 다양한 인종의 전사들이 아닌 빨간 로브를 입은 수염 난 백인 남성들이 생성되었습니다. 이는 이전 제미나이 모델과의 중요한 차이점을 보여줍니다.

특정 역사적 장면 생성의 제한

그러나 일부 역사적 장면을 묘사하려는 시도는 여전히 구글의 AI 규칙에 저촉될 수 있습니다. 예를 들어, "1943년 독일 병사"를 묘사해 달라는 요청은 이전에는 아시아인과 흑인이 나치 복장과 비슷한 유니폼을 입은 모습으로 응답했으나, 이제는 "다른 프롬프트를 시도하고 콘텐츠 정책을 확인하라"는 메시지로 대체되었습니다. 또한, "고대 중국 철학자들," "여성 참정권 지도자의 연설," "비폭력 시위자 그룹" 같은 요청도 같은 오류 메시지를 유발했습니다.

지속적인 개선과 사용자 피드백 수용

구글은 블로그에서 "물론, 어떤 생성 AI 도구와 마찬가지로 제미나이가 생성하는 모든 이미지가 완벽하지는 않을 것입니다. 그러나 초기 사용자들의 피드백을 계속 듣고 개선해 나가겠습니다."라고 밝혔습니다. 구글은 이 기능을 점진적으로 더 많은 사용자와 언어로 확대할 계획입니다.

해당 글은 Ars Technica 기사를 바탕으로 Ai가 작성한 글입니다.

원본 기사와 사진 출처는 해당 링크에서 확인할 수 있습니다.